AI/データサイエンス

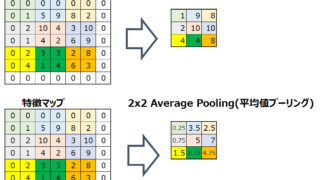

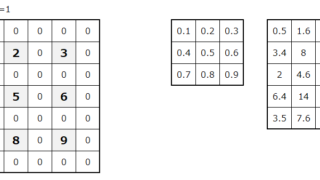

AI/データサイエンス 【ディープラーニング】CNNとは何か – 畳み込みニューラルネットワークを徹底解説

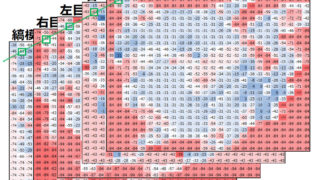

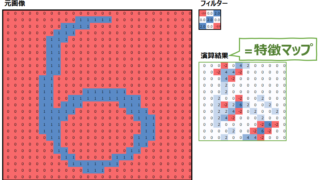

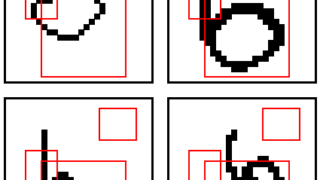

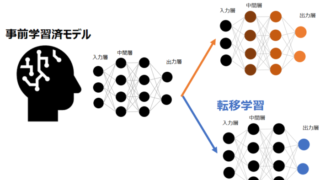

CNN(Convolutional Neural Network)、日本語で畳み込みニューラルネットワークは、ディープラーニングの技術の一種で、特に画像処理分野での応用が広く知られています。我々の生活環境において、知らず知らずのうちにCNN...

AI/データサイエンス

AI/データサイエンス  AI/データサイエンス

AI/データサイエンス  AI/データサイエンス

AI/データサイエンス  AI/データサイエンス

AI/データサイエンス  AI/データサイエンス

AI/データサイエンス  AI/データサイエンス

AI/データサイエンス  AI/データサイエンス

AI/データサイエンス  AI/データサイエンス

AI/データサイエンス  AI/データサイエンス

AI/データサイエンス  AI/データサイエンス

AI/データサイエンス