AIに関しては、”定理”や”ルール”と呼ばれている者が複数存在します。以下に代表的なものを紹介します。

ノーフリーランチ定理

機械学習において、あらゆる問題を効率よく解ける万能のモデルは存在しない、という定理。

そもそも英語における一般的な表現として、”no free lunch”というのは、日本語でいう”タダより安い物はない”というニュアンスがあるが、機械学習においては上述の通り、万能なモデルは存在しない、という文脈で使われる。

バーニーおじさんのルール

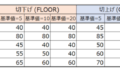

学習にはパラメータ数のおよそ10倍のデータサンプルが必要、という経験則のこと。ディープラーニングの場合は入力の数と中間層の数が多くなり、それに従って全体のパラメータの数も爆発的に多くなる。例えばILSVR2012で優勝したAlexNetは約6000万のパラメータを持ち、6億個のデータを要した。

バーニーおじさんというのは、スタンフォード大学のBernard widrow氏がIEEEでの講演にて自ら上述のルールを提唱したことに由来すると考えられる。

みにくいアヒルの子の定理

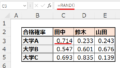

真に客観的な立場からは、どんなものを比較しても同程度に似ているとしか言えない、という定理。定理名の由来であるアヒルと白鳥についても、鳥の種類という前提知識がなければ、白鳥の子は単にほかのアヒルの子たちと同じくらいの違いしかない、ということ。

機械学習においては仮定を置かずして分類は不可能、分類問題は暗黙の了解や事前知識のある類似性をもとにしか解くことができない、という意味になる。

次元の呪い

次元、つまりディープラーニングでいう特徴量が増えるほど、高精度のモデルを構築するために必要な訓練データの数が指数関数的に増えてしまうこと。

コメント