AI/データサイエンス

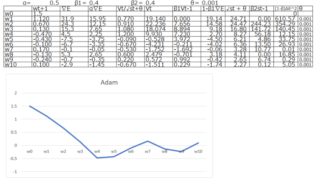

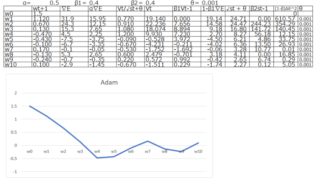

AI/データサイエンス 【機械学習】Optimizer(最適化関数) – SGD、Momentum、AdaGrad、RMSProp、Adamとは何か

過去の記事で勾配降下法では大域的最適解に辿り着けない問題を紹介しました。今回はその解決手法であるOptimizer(最適化関数)について、SGD、Momentum、AdaGrad、RMSProp、Adamを例に解説します。

AI/データサイエンス

AI/データサイエンス  AI/データサイエンス

AI/データサイエンス